2021년 1월 6일 폭동 폭도가 미국 국회의사당에서 반란을 시도했습니다. 소셜 미디어 게시물은 참가자들이 참여하도록 워싱턴 D.C.로 유인하는 데 도움이 되었습니다. 그들은 Joe Biden의 선거 승리에 도전하기 위해 온 백인 우월주의 증오 단체의 구성원을 포함했습니다.

투표, 재검표 및 법원 검토를 통해 2020년 미국 대통령 선거에서 Biden의 확실한 승리가 입증되었습니다. 그러나 많은 소셜 미디어는 도널드 트럼프가 더 많은 표를 얻었다고 거짓 주장을 했습니다. 그 게시물 중 일부는 또한 사람들에게 1월 6일 워싱턴 D.C.로 모여들 것을 촉구했습니다. 그들은 사람들이 의회가 선거 결과를 받아들이지 못하도록 막도록 독려했습니다. 일부 게시물은 도시에 총을 반입하는 방법에 대해 논의하고 “전쟁”에 대해 이야기했습니다.

트럼프 등의 항의가 담긴 집회는 군중을 더욱 들썩이게 했다. 그런 다음 폭도들은 미국 국회 의사당으로 행진했습니다. 폭도들은 바리케이드를 통과한 후 강제로 안으로 들어갔습니다. 5명이 사망하고 100명 이상의 경찰관이 부상을 입었습니다. 나중에 조사를 통해 백인 우월주의 증오 단체의 구성원이 이 반란과 연결되었습니다.

편견과 증오는 새로운 것이 아닙니다. 그러나 온라인 웹 사이트와 소셜 미디어는 그 힘을 증폭시킨 것 같습니다. 그리고 국회 의사당 행사에서처럼 온라인 증오는 실제 폭력으로 이어질 수 있습니다.

지난 여름 위스콘신 주 케노샤에서 분노가 폭발했습니다. 경찰은 비무장 남성을 그의 아이들 앞에서 일곱 번 쐈습니다. 아프리카계 미국인 남성은 흑인에 대한 과도한 경찰력의 최근 희생자였습니다. 폭력과 인종 차별의 다른 영향에 항의하기 위해 군중이 모였습니다.

비무장 흑인은 비무장 백인보다 경찰의 총에 맞을 확률이 더 높습니다. 그러나 일부 사람들은 시위에 반대했습니다. 그들은 시위대를 범죄자이자 “사악한 깡패”로 묘사했습니다. 많은 소셜 미디어 게시물은 “애국자”에게 무기를 들고 Kenosha를 “방어”할 것을 촉구했습니다. 이 게시물은 8월 25일 자경단 반 시위대를 Kenosha로 끌어들였습니다. 그들 중에는 불법적으로 총을 소지한 일리노이주 출신의 십대도 있었습니다. 그날 밤 그와 다른 사람들은 무기를 들고 도시를 돌아다녔습니다. 자정까지 십대는 세 명의 남자를 쐈습니다. 경찰은 그를 살인 등 범죄 혐의로 기소했다. 그러나 일부 온라인 게시물은 살인자를 영웅이라고 불렀습니다. 그리고 인종 정의 시위에 대한 혐오 게시물이 계속되었습니다.

이러한 2020년 이벤트는 그러한 일련의 긴 사건의 일부입니다.

예를 들어 2018년에는 펜실베이니아 주 피츠버그에 있는 회당에서 총격 사건으로 11명이 사망했습니다. 그는 Gab 웹 사이트에서 활동했습니다. 남부빈곤법센터(Southern Poverty Law Center)에 따르면 그것은 남성의 “인종차별적 선전의 꾸준한 온라인 소비”를 공급했습니다. 2017년 메릴랜드 대학교의 한 대학생이 버스 정류장에서 방문했던 흑인 학생을 칼로 찔렀습니다. 범인은 여성, 유대인, 아프리카계 미국인에 대한 증오심을 불러일으키는 페이스북 그룹의 일원이었습니다. 그리고 2016년에는 사우스캐롤라이나주 찰스턴에 있는 한 교회에서 한 총잡이가 흑인 9명을 살해했습니다. 연방 당국은 온라인 소식통이 “백인을 위해 싸우고 백인 우월주의를 성취하려는” 그의 열정에 불을 붙였다고 말했습니다.

그러나 온라인 증오가 사람들을 해치기 위해 신체적으로 변할 필요는 없습니다. 심리적인 피해를 주기도 합니다. 최근에 연구원들은 6개국에서 18세에서 25세 사이의 사람들을 조사했습니다. 작년에 그들은 Deviant Behavior 저널에 연구 결과를 보고했습니다. 대다수는 지난 3개월 이내에 온라인 증오에 노출되었다고 말했습니다. 대부분은 우연히 게시물을 발견했다고 말했습니다. 그리고 조사 대상자 10명 중 4명 이상이 게시물이 그들을 슬프게 하고, 증오하고, 화나게 하고, 부끄럽게 만들었다고 말했습니다.

민권 단체, 교육자 등이 이 문제를 해결하기 위해 노력하고 있습니다. 과학자들과 엔지니어들도 싸움에 뛰어들고 있습니다. 일부는 온라인 증오가 번성하고 확산되는 방식을 연구하고 있습니다. 다른 사람들은 인공 지능을 사용하여 증오 게시물을 차단하거나 차단합니다. 그리고 일부는 증오에 맞서 싸우는 방법으로 반대 발언 및 기타 전략을 모색하고 있습니다.

온라인 증오 확산 방식

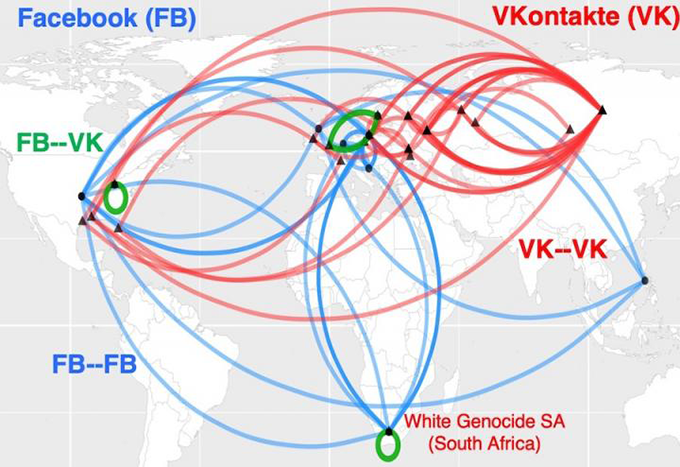

소셜 미디어 사이트는 허용되는 게시물에 대한 규칙을 위반하는 사람들을 정지 또는 금지할 수 있습니다. 그러나 여기서 책임을 져야 할 사람은 소수만이 아닙니다. Neil Johnson은 “우리가 보는 집단 행동에 더 가깝습니다.”라고 말합니다. 그는 워싱턴 D.C.에 있는 조지 워싱턴 대학교의 물리학자입니다.

Johnson과 다른 사람들은 다양한 소셜 미디어 플랫폼의 공개 데이터를 분석했습니다. 온라인 증오 집단이 그룹으로 조직되는 것 같다고 그들은 발견했습니다. 많은 다른 사람들이 이 그룹에 글을 올립니다. 게시물은 또한 다른 그룹과 상호 연결됩니다. 그룹 간의 링크는 서로 다른 소셜 미디어 플랫폼 간의 네트워크를 형성합니다.

어떤 면에서 온라인 증오는 다중 우주와 같다고 그는 말합니다. 그 개념은 다른 우주가 다른 현실과 함께 존재한다고 주장합니다. Johnson은 각 소셜 미디어 또는 게임 플랫폼을 별도의 우주에 비유합니다. 플랫폼에는 자체 규칙이 있습니다. 그리고 그들은 독립적으로 작동합니다. 그러나 일부 공상과학 캐릭터가 다른 우주로 이동할 수 있는 것처럼 온라인 사용자는 다른 플랫폼으로 이동할 수 있습니다. 어느 한 사이트가 혐오스럽거나 폭력적인 게시물을 단속하면 나쁜 행위자는 다른 곳으로 갈 수 있습니다.

나쁜 행위자를 금지하는 것만으로는 문제가 해결되지 않을 것이라고 그는 결론지었습니다. Johnson과 그의 팀은 2019년 8월 21일 Nature에 연구 결과를 공유했습니다.

소셜 미디어 플랫폼을 통해 사람들은 증오의 영향을 증폭시킬 수 있습니다. 예를 들어 유명인사들이 혐오스러운 것을 공유하면 다른 많은 사람들이 그것을 반복할 것이라고 예상할 수 있습니다. 다른 사람들은 봇으로 자신의 에코 챔버를 만들 수 있습니다. 그 봇은 행동이 인간처럼 보이도록 의도된 컴퓨터 프로그램입니다. 사람들은 종종 봇을 사용하여 혐오스럽거나 잘못된 정보를 반복해서 반복합니다. 그렇게 되면 혐오스러운 생각이 실제보다 더 널리 퍼진 것처럼 보일 수 있습니다. 그리고 그것은 결국 그러한 견해가 수용 가능하다고 잘못 암시할 수 있습니다.

Brandie Nonnecke는 University of California, Berkeley의 CITRIS Policy Lab을 이끌고 있습니다. 최근 그녀와 다른 사람들은 여성의 생식권에 관한 게시물에서 봇의 사용을 살펴보았습니다. 팀은 12일 동안 170만 개 이상의 트윗 샘플을 스크랩하거나 수집했습니다. (그녀는 또한 조사를 위해 Twitter에서 데이터를 스크랩하려는 다른 사람들을 위해 평이한 언어 가이드를 작성했습니다.)

“생명 찬성”과 “선택 찬성” 측 모두 Twitter 정책에 정의된 대로 악의적인 봇을 사용했습니다. 그러나 프로 라이프 봇은 괴롭히는 게시물을 만들고 반향하는 경향이 더 컸습니다. 그들의 말은 불쾌하고 저속하며 공격적이거나 모욕적이었습니다. 찬성 봇은 분열을 부추길 가능성이 더 컸습니다. 예를 들어 그들은 우리 대 그들 입장을 취할 수 있습니다. Institute for the Future는 2019년 보고서에서 이러한 결과를 발표했습니다.

증오 선별

수십만 개의 게시물을 분류하는 데는 시간이 걸린다고 Nonnecke는 밝혔습니다. 많은 시간. 작업 속도를 높이기 위해 일부 과학자들은 인공 지능을 사용하고 있습니다.

인공 지능 또는 AI는 알고리즘이라는 일련의 컴퓨터 명령에 의존합니다. 이것들은 패턴이나 사물 사이의 연결을 발견하는 법을 배울 수 있습니다. 일반적으로 AI 알고리즘은 데이터를 검토하여 서로 다른 항목을 그룹화하거나 분류하는 방법을 학습합니다. 그런 다음 알고리즘은 다른 데이터를 검토하고 분류하거나 어떤 유형의 조치를 취할 수 있습니다. 주요 소셜 미디어 플랫폼에는 이미 증오심 표현이나 거짓 정보를 표시하는 AI 도구가 있습니다. 그러나 온라인 증오를 분류하는 것은 간단하지 않습니다.

때때로 AI 도구는 악의적이지 않은 게시물을 차단합니다. 예를 들어 2020년 3월 Facebook은 뉴스 기사를 공유하던 많은 게시물을 차단했습니다. 기사는 증오, 거짓말 또는 스팸(원치 않는 광고)이 아니었습니다. 회사 대표인 Mark Zuckerberg는 나중에 원인이 “기술적 오류”라고 말했습니다.

일부 AI 오류는 역효과를 낼 수도 있습니다. “알고리즘은 우리처럼 언어를 이해하지 못합니다.”라고 Brendan Kennedy는 말합니다. 그는 로스앤젤레스에 있는 서던캘리포니아대학교에서 컴퓨터 공학을 전공하는 대학원생입니다. 종종 알고리즘은 “‘흑인’, ‘무슬림’ 또는 ‘유대인’이라는 용어를 보고 이것이 혐오 발언이라고 가정할 수 있습니다”라고 그는 말합니다. 그것은 편협함에 실제로 반대하는 게시물을 차단하는 프로그램으로 이어질 수 있습니다.

Kennedy는 “증오심 표현이 무엇인지 실제로 학습하는 알고리즘을 개발하려면 이러한 사회 집단 용어가 나타나는 맥락을 고려하도록 강제해야 했습니다.”라고 설명합니다. 그의 그룹은 규칙을 사용하여 이러한 AI 접근 방식을 개발했습니다. 용어가 사용되는 방식을 기반으로 연설을 평가합니다. 그는 2020년 7월 전산 언어학 협회 회의에서 이 방법을 발표했습니다.

특정 키워드만 찾는 알고리즘도 욕설 게시물을 놓칠 수 있습니다. 예를 들어 Facebook의 내장 도구는 시위자에 대한 혐오스러운 밈과 사람들에게 Kenosha에서 무기를 들라고 말하는 게시물을 차단하지 않았습니다. 그리고 살인 이후 플랫폼은 십대 총격범을 칭찬하는 일부 게시물을 자동으로 차단하지 않았습니다.

그러나 맥락에 관해서는 게시물이 어떤 범주에 속할 수 있는지에 대해 여전히 “많은 불확실성”이 있을 수 있다고 Thomas Mandl은 말합니다. 그는 정보 과학자입니다. 그는 독일의 Hildesheim 대학교에서 근무하고 있습니다. Mandl은 인도의 연구원들과 함께 “사이버 감시” 도구를 만들었습니다. 사람들이 Facebook 및 Twitter에서 사용할 수 있도록 설계되었습니다.

증오심 표현에 라벨을 붙이고 걸러내려면 AI 알고리즘이 엄청난 양의 데이터 세트로 교육을 받아야 한다고 Mandl은 말합니다. 일부 인간은 먼저 이러한 학습 데이터에서 항목을 분류해야 합니다. 그러나 종종 게시물은 증오 그룹 구성원에게 어필하기 위한 언어를 사용합니다. 그룹 외부의 사람들은 이러한 용어를 받아들이지 않을 수 있습니다. 또한 많은 게시물은 독자가 이미 특정 사항을 알고 있다고 가정합니다. 이러한 게시물에는 알고리즘이 검색하는 용어가 반드시 포함되어 있지는 않습니다.

“이 게시물은 너무 짧고 사전 지식이 많이 필요합니다.”라고 Mandl은 말합니다. 그런 배경 없이는 “당신은 그들을 이해하지 못합니다.”라고 그는 말합니다.

예를 들어 미국에서 트럼프는 2016년 미국-멕시코 국경을 따라 “장벽을 건설”하겠다고 약속했습니다. 이 문구는 나중에 난민과 다른 이주자에 대한 불쾌한 말의 약칭이 되었습니다. 마찬가지로 인도에서도 무슬림에 대한 온라인상의 증오는 독자들이 나렌드라 모디 총리가 지지하는 반무슬림 입장에 대해 알고 있다고 가정하는 경우가 많습니다.

Mandl의 팀은 영어, 독일어 및 힌디어로 된 게시물을 스캔할 수 있는 브라우저 플러그인을 만들었습니다. 빨간색, 노란색 또는 녹색으로 구절을 강조 표시합니다. 이 색상은 게시물이 노골적으로 공격적인지(빨간색), 더 미묘하게 공격적인지(노란색) 또는 공격적이지 않은지 경고합니다. 사용자는 공격적인 게시물을 차단하도록 도구를 설정할 수도 있습니다. 도구의 정확도는 약 80%입니다. Mandl은 일반적으로 사람들의 약 80%만이 게시물에 대한 평가에 동의한다는 점을 감안할 때 나쁘지 않다고 말합니다. 팀은 2020년 12월 15일 전문가 시스템과 응용 프로그램에서 작업을 설명했습니다.

반론

반론은 게시물을 검열하거나 차단하는 것 이상입니다. 대신 적극적으로 온라인 혐오를 약화시키려 합니다. 불쾌한 게시물에 대한 응답은 그것을 조롱하거나 머리를 뒤집을 수 있습니다. 예를 들어 게시물은 #BuildTheWall과 #TearDownThisWall을 대조할 수 있습니다. 로널드 레이건 미국 대통령은 1987년 독일의 옛 베를린 장벽 연설에서 이 두 번째 문구를 사용했습니다.

반론은 아마도 온라인 혐오자들의 마음을 바꾸지 못할 것입니다. 그러나 그것은 온라인 연설이 용납할 수 없는 언어로 선을 넘는 손가락을 가리킨다. 그리고 새로운 연구에 따르면 조직적인 반론 노력이 온라인 증오의 양을 줄일 수도 있다고 합니다.

Mirta Galesic은 뉴멕시코 산타페 연구소의 심리학자입니다. 그녀와 다른 사람들은 독일에서 온라인 증오와 반론을 조사했습니다. 그들은 온라인 증오와 반대 발언을 모두 감지하는 AI 도구를 만들었습니다. 그런 다음 두 그룹에 연결된 사람들의 수백만 트윗으로 AI를 훈련했습니다.

첫 번째 그룹에는 Reconquista Germanica(RG)로 알려진 증오 기반 조직의 구성원 2,120명이 있었습니다. 반대 연설 그룹은 Reconquista Internet(RI)이라는 운동의 핵심 구성원 103명으로 시작되었습니다. 더 많은 데이터를 얻기 위해 팀은 최소 5명의 RI 회원을 적극적으로 팔로우한 사람들을 추가했습니다. (그 사람들의 트위터 약력도 RI 회원들의 전형적인 언어를 사용했습니다.) 이로 인해 반박 계정이 1,472개로 늘었습니다.

“이 두 그룹의 아름다움은 자체 라벨링이었습니다.”라고 Galesic은 말합니다. 즉, 사람들은 자신의 게시물이 어떤 그룹에 속하는지 분명히 했습니다. AI는 이러한 트윗을 통해 학습한 내용을 사용하여 다른 게시물을 증오, 반론 또는 중립으로 분류했습니다. 한 그룹의 사람들도 동일한 게시물의 샘플을 검토했습니다. AI 분류는 사람이 수행한 분류와 잘 일치했습니다.

그런 다음 Galesic의 팀은 AI 도구를 사용하여 정치적 문제에 대한 트윗을 분류했습니다. 이 작업에는 2013년에서 2018년 사이에 100,000건 이상의 대화가 포함되었습니다. 이 보고서는 11월 온라인 학대 및 피해에 관한 워크숍의 일부였습니다.

Galesic과 그녀의 동료들은 또한 트위터에서 증오와 반대 발언의 양을 비교했습니다. 데이터는 2015년부터 2018년까지 정치에 관한 180,000개 이상의 독일 트윗에서 수집되었습니다. 온라인 증오 게시물은 4년 내내 반대 발언보다 많았습니다. 그동안 반론 비중은 크게 늘지 않았다. 그 후 2018년 5월에 RI가 활성화되었습니다. 이제 반론 및 중립 게시물의 비율이 증가했습니다. 그 후 증오 트윗의 비율과 극단적 성격이 모두 떨어졌습니다.

이 한 가지 사례 연구는 RI의 노력이 혐오 트윗의 감소를 초래했다는 것을 증명하지 않습니다. 그러나 증오심 표현에 대응하기 위한 조직적인 노력이 도움이 될 수 있음을 시사합니다.

Galesic은 반대 연설 게시물의 가능한 영향을 “실제 환경에서 괴롭힘에 맞서는 어린이 그룹이 괴롭힘에 맞서는 한 명의 어린이보다 더 성공적일 수 있는 방식”과 비교합니다. 여기에서 사람들은 온라인 증오의 피해자를 위해 일어섰습니다. 또한 그녀는 당신이 “증오심 표현은 옳지 않다”는 주장을 강화한다고 말합니다. 그리고 증오에 반대하는 트윗을 많이 내보냄으로써 독자들은 많은 사람들이 이런 식으로 느낀다는 인상을 받게 될 것이라고 그녀는 덧붙입니다.

Galesic의 그룹은 이제 어떤 유형의 개인 반론 전술이 가장 도움이 될지 조사하고 있습니다. 그녀는 십대들에게 많은 생각을 하지 않고 싸움에 뛰어들지 말라고 경고합니다. “많은 욕설이 관련되어 있습니다.”라고 그녀는 지적합니다. “때때로 실제 생명의 위협도 있을 수 있습니다.” 하지만 어느 정도 준비를 하면 십대들은 긍정적인 조치를 취할 수 있습니다.

십대들이 도울 수 있는 방법

사회학자 Kara Brisson-Boivin은 MediaSmarts에서 연구를 이끌고 있습니다. 캐나다 오타와에 있습니다. 2019년에 그녀는 1,000명 이상의 젊은 캐나다인을 대상으로 한 설문 조사에 대해 보고했습니다. 모두 12~16세였다. Brisson-Boivin은 “80%는 온라인에서 증오를 볼 때 무언가를 하고 무언가를 말하는 것이 중요하다고 생각한다고 말했습니다. “그러나 그들이 아무것도 하지 않은 가장 큰 이유는 그들이 무엇을 해야 할지 모른다고 느꼈기 때문입니다.”

“당신은 항상 무언가를 할 수 있습니다.”라고 그녀는 강조합니다. “그리고 당신은 항상 무언가를 할 권리가 있습니다.” 그녀의 그룹은 도움이 되는 팁 시트를 작성했습니다. 예를 들어 증오 게시물의 스크린샷을 찍어 신고할 수 있다고 그녀는 지적합니다.

친구가 상처를 주는 글을 올렸는데 당신이 공개적으로 말하기를 꺼린다고 가정해 봅시다. MediaSmarts 팁 시트에는 친구에게 상처를 받았다고 개인적으로 말할 수 있다고 나와 있습니다. 게시물로 인해 다른 사람이 상처를 받을 수 있다고 생각되면 개인적으로 관심을 갖고 지원한다고 말할 수 있습니다. 그리고 당신이 아는 어른이 혐오스러운 글을 올리면 부모나 선생님에게 말하세요. 팁 시트는 또한 공개적으로 안전하게 말하는 방법을 제안합니다.

Brisson-Boivin은 말합니다. 예를 들어 게시물의 잘못된 정보를 수정할 수 있습니다. 상처를 주는 이유를 말할 수 있습니다. 주제를 변경할 수 있습니다. 그리고 상처를 주는 온라인 대화에서 언제든지 벗어날 수 있습니다.

슬프게도 온라인 증오는 곧 사라지지 않을 것입니다. 그러나 더 나은 컴퓨터 도구와 과학 기반 지침은 우리 모두가 온라인 증오에 맞서는 데 도움이 될 수 있습니다.